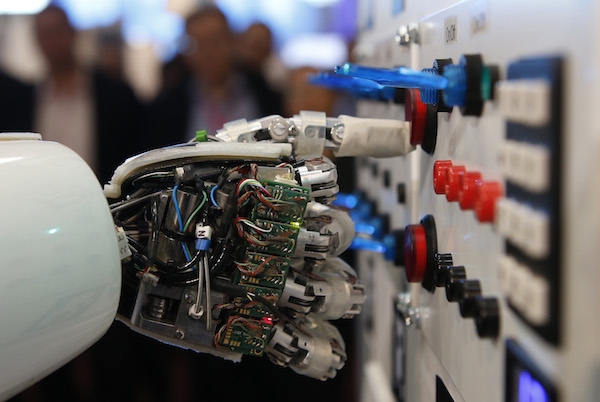

รถอัจฉริยะไร้คนขับ โดรน ระบบการวิเคราะห์ใบหน้าแม้อยู่ในที่มืดสนิท ระบบเครือข่ายอัจฉริยะที่สามารถควบคุมเมืองทั้งเมืองได้ หุ่นยนต์แมงมุมที่มีความสามารถในการเคลื่อนที่แม้อยู่ในสภาพภูมิประเทศทุรกันดาร ฯลฯ เหล่านี้อาจเป็นเทคโนโลยีที่น่าตื่นตาตื่นใจ แต่จะเป็นอย่างไร หากเทคโนโลยีเหล่านี้ไปมีชื่ออยู่ในโครงการพัฒนาอาวุธทางการทหารที่อภิมหาอำนาจของโลกอย่างสหรัฐอเมริกา และรัสเซียเร่งพัฒนากันอยู่ รวมไปถึงการใช้เทคโนโลยีปัญญาประดิษฐ์ (Artificial Intelligence : AI) ไปพัฒนาเป็น "AI Weapon" อาวุธทรงประสิทธิภาพที่มีความสามารถในการทำลายเป้าหมายได้โดยที่มนุษย์ไม่จำเป็นต้องเข้าควบคุม

หากมองย้อนหลังไปสักสิบปี ชื่อของเทคโนโลยีปัญญาประดิษฐ์ หรือ AI เป็นชื่อที่เคยได้รับความสนใจในวงกว้าง และมีการพัฒนาในเชิงลึกมาอย่างต่อเนื่อง จนถึงวันนี้ ไม่น่าแปลกใจที่ชื่อของ AI Weapon ได้กลายเป็นชื่อที่สร้างความวิตกกังวลในหมู่ผู้เชี่ยวชาญด้านเทคโนโลยีเป็นอันมาก ด้วยเกรงว่าอาวุธทรงอาณุภาพชิ้นนี้จะปฏิวัติภาพของสงครามที่คนรุ่นก่อนรู้จักไปอย่างสิ้นเชิง

การก่อกำเนิดองค์กรอย่าง The Russian Advanced Research Foundation หรือ ARF ของรัสเซียในปี ค.ศ. 2012 ซึ่งมีรูปแบบคล้ายคลึงกับหน่วยงานของสหรัฐอเมริกาอย่าง The US Defense Advanced Research Projects Agency หรือ DAPRA (ก่อตั้งในปี ค.ศ. 1958) นั้นก็เป็นสิ่งที่ยืนยันได้ดีถึงการก้าวเข้าสู่ยุค AI Weapon อย่างเป็นทางการ อีกทั้งยังเป็นการอวดศักยภาพทางด้านเทคโนโลยีการทหารของตนเองกลาย ๆ ด้วย

โดยหากพิจารณาจากโครงการวิจัยของ ARF ที่เผยแพร่ผ่าน Russia Beyond the Headlines (RBTH) เมื่อปี ค.ศ. 2013 จะพบว่า มีโครงการวิจัยที่เข้าข่าย AI Weapon อยู่มากมาย ไม่ว่าจะเป็นการพัฒนาหุ่นยนต์แมงมุม (Life Support Spider robot) ที่สามารถนำยา - อุปกรณ์ช่วยชีวิตเข้าไปในสมรภูมิ ไปจนถึงการพัฒนาหุ่นยนต์เทอร์มิเนเตอร์ (Terminator) ที่สามารถวิ่งและกระโดดข้ามสิ่งกีดขวาง รวมถึงสามารถปลิดชีวิตกองกำลังมนุษย์ฝ่ายตรงข้ามได้ด้วย

ล่าสุดได้มีรายงานเพิ่มเติมออกมาจาก RT สื่อของรัสเซียด้วยว่าหุ่นยนต์เทอร์มิเนเตอร์ดังกล่าวนั้น พร้อมจะออกวิ่งได้แล้วภายในสิ้นปีนี้

ซึ่งหากอ้างอิงจากคำให้สัมภาษณ์ของ มร.อังเดรย์ กริกอเยฟ (Andrey Grigoryev) ผู้อำนวยการ ARF ซึ่งให้สัมภาษณ์ถึงความสามารถของหุ่นยนต์ล่าสังหารแล้วจะพบว่า นอกจากมีรูปร่างคล้ายมนุษย์ และสามารถวิ่ง - กระโดดข้ามสิ่งกีดขวางได้แล้ว มันยังสามารถ "ทำกิจกรรมอื่น ๆ" ได้ตามที่ผู้ควบคุมกำหนดอีกด้วย

โดยภารกิจที่หุ่นยนต์ดังกล่าวจะได้รับมอบหมายนั้นจะเป็นการทำงานในสภาพแวดล้อมที่อันตรายขั้นร้ายแรง และผู้ควบคุมไม่จำเป็นต้องลงพื้นที่ไปกับหุ่นยนต์แต่อย่างใด

สื่อรัสเซียรายงานอีกด้วยว่า นับตั้งแต่ก่อตั้ง ARF ขึ้นในปี ค.ศ.2012 นั้น โครงการจาก ARF ได้รับอนุญาตจากรัฐบาลกลางรัสเซียไปแล้วถึง 53 โปรเจกต์ และอยู่ระหว่างการวิจัยจำนวน 31 โปรเจกต์เลยทีเดียว

อย่างไรก็ดี ยังมีความเคลือนแคลงอยู่พอสมควรกับความสามารถของหุ่นยนต์จากฝั่งรัสเซีย เนื่องจากงบประมาณที่ ARF ได้รับในการดำเนินงานนั้นแม้ทางตัวหน่วยงานเองจะออกมาบอกว่า "เพียงพอ" แต่ก็ยังถือว่าน้อยมากเมื่อเทียบกับ DAPRAของสหรัฐอเมริกา โดย ARF ได้รับงบประมาณอยู่ที่ 100 ล้านเหรียญสหรัฐ ขณะที่ของ DAPRA นั้นมีงบประมาณให้ถลุงมากถึง 2.8 พันล้านเหรียญสหรัฐ

ยิ่งไปกว่านั้น ทางด้านสหรัฐอเมริกาเองก็มีความเคลื่อนไหวออกมาเช่นกัน โดยแผนงบประมาณปี ค.ศ. 2016 ของเพนตากอนได้ถูกปรับเพิ่มสูงกว่าเพดานงบประมาณเดิมที่กำหนดโดยสภาคองเกรส โดยสาเหตุของการเพิ่มงบประมาณก้อนนี้ รายงานข่าวจากรอยเตอร์ระบุว่าเกิดจากความวิตกกังวลว่าประเทศอย่างจีน - รัสเซียกำลังพัฒนาอาวุธทรงอาณุภาพ ทำให้ทางการสหรัฐต้องเพิ่มงบประมาณให้กับเพนตากอนในที่สุด

โดยงบประมาณก้อนนี้จะประกอบด้วย การลงทุนด้านอาวุธนิวเคลียร์, การพัฒนาเซ็นเซอร์ชั้นสูง, การพัฒนาระบบป้องกันขีปนาวุธ, รวมไปถึงความสามารถในแวดวงไซเบอร์, การพัฒนาพาหนะไร้คนขับใต้ทะเล, การทำเหมืองกลางทะเล, อาวุธโจมตีความเร็วสูง, เครื่องยนต์เครื่องบินขับไล่ชั้นสูง, เลเซอร์พลังงานสูง และเทคโนโลยีปืนแม่เหล็กไฟฟ้า Railgun

การแข่งขันด้านเทคโนโลยีทางการทหารที่สองประเทศคานอำนาจกันอยู่นั้นยังได้แสดงให้เห็นด้วยว่าเทคโนโลยีใด ๆ ก็เป็นสิ่งที่มีค่า และสามารถนำมาพัฒนาต่อเป็นอาวุธได้ทั้งสิ้น ไม่ว่าจะเป็นการนำโดรนไปใช้ช่วยเล็งเป้าหมาย - วิเคราะห์การรบ การพัฒนาชุดพรางตัวที่สามารถเปลี่ยนสีได้ตามสภาพแวดล้อม การพัฒนาระบบเครือข่ายขั้นสูง (Smart Network) ที่สามารถสะกดรอย - ควบคุมผู้ที่เป็นเป้าหมายของรัฐบาลได้ทุกฝีก้าว รวมไปถึงการพัฒนาทหารแอนดรอยด์ออกวิ่งไปในสมรภูมิโดยไม่หวั่นว่าจะถูกยิงเสียชีวิต

นั่นจึงนำไปสู่การเผยแพร่ "จดหมายเปิดผนึกครั้งสำคัญ" ผ่านการประชุม the International Joint Conference on Artificial Intelligence ในกรุงบัวโนสไอเรส ประเทศอาร์เจนติน่า เมื่อปลายเดือนกรกฎาคมที่ผ่านมา ภายใต้การรวมตัวกันของนักวิทยาศาสตร์ชื่อดัง และผู้เชี่ยวชาญในวงการเทคโนโลยีอย่าง ศาสตราจารย์สตีเฟน ฮอว์กกิ้ง (Prof. Stephen Hawking) อัจฉริยะด้านวิทยาศาสตร์, อีลอน มัสก์ (Elon Musk) นักธุรกิจคนดังเจ้าของบริษัท Space X, สตีฟ วอซเนียก (Steve Wozniak) ผู้ร่วมก่อตั้งบริษัทแอปเปิล, Jaan Tallinn ผู้ร่วมก่อตั้ง Skype, Max Tegmark นักฟิสิกส์ชื่อดังและอื่น ๆ อีกมากมาย

โดยใจความสำคัญของจดหมายคือการสื่อว่าโลกควรจะยับยั้งไม่ให้ AI Weapon นั้นเกิดขึ้น เนื่องจากพวกเขาเชื่อว่า การพัฒนาหุ่นยนต์ล่าสังหารแบบในภาพยนตร์เรื่องเทอร์มิเนเตอร์กำลังรุดหน้าไปอย่างรวดเร็ว

อีกทั้งมีความวิตกกังวลว่า อาวุธสังหารเหล่านี้จะตกไปอยู่ในมือผู้ก่อการร้าย ผู้นำเผด็จการหรือเหล่าจอมพลที่มีจุดประสงค์ "ฆ่าล้างเผ่าพันธุ์" และนำมาซึ่งอันตรายอย่างใหญ่หลวงด้วย

แม้ในตอนท้ายของจดหมายเปิดผนึกดังกล่าวจะพยายามชี้ทางของการใช้ AI Weapon ที่เหมาะสมสำหรับภารกิจทางการทหาร เช่น การบอกว่าระบบ AI น่าจะช่วยลดการสูญเสียชีวิตพลเรือนผู้บริสุทธิ์ในระหว่างสงคราม หรือการทำให้สมรภูมิรบปลอดภัยสำหรับมนุษย์มากขึ้น แต่ในความเป็นจริง สงครามไม่ได้เกิดขึ้นเพื่อรักษาชีวิตมนุษย์แต่อย่างใด ตรงกันข้าม มันเกิดขึ้นเพื่อต้องการรักษา "ผลประโยชน์" ของใครบางคนต่างหาก

ที่สำคัญ หากสงครามในรูปแบบของ AI Weapon เกิดขึ้นจริง เราอาจไม่ได้เห็นจุดจบของสงครามแบบที่เคยเกิดขึ้นเมื่อครั้งสงครามโลกครั้งที่สอง ที่เมืองฮิโรชิมาและนางาซากิเต็มไปด้วยคราบน้ำตาของผู้สูญเสียจากภัยปรมาณู เพราะด้วยอิทธิฤทธิ์ของ AI Weapon มนุษย์อาจสิ้นชีวิตไปทั้งที่ยังไม่ได้หลั่งน้ำตาด้วยซ้ำ