สะเทือนวงการความมั่นคงปลอดภัยทางไซเบอร์โลกอีกครั้ง เมื่อทีมข่าวกรองภัยคุกคามของ Google ออกโรงเปิดเผยด้วยความมั่นใจระดับสูงว่า กลุ่มอาชญากรไซเบอร์ได้นำเทคโนโลยีปัญญาประดิษฐ์ (AI) มาใช้เป็นอาวุธในการค้นหาและสร้างชุดคำสั่งเจาะช่องโหว่ประเภท Zero-Day เพื่อเจาะระบบเครื่องมือผู้ดูแลระบบชื่อดัง ซึ่งการโจมตีครั้งนี้ล้ำลึกถึงขั้นเจาะผ่านระบบยืนยันตัวตนแบบสองปัจจัย (2FA) ซึ่งเป็นปราการด่านสำคัญที่มักใช้ปกป้องบัญชีและกระเป๋าเงิน คริปโต ปรากฏการณ์นี้สะท้อนให้เห็นถึงภัยคุกคามรูปแบบใหม่ที่ AI กำลังถูกเปลี่ยนให้เป็นเครื่องมือโจมตีเชิงรุก สร้างความท้าทายครั้งใหญ่ต่อความมั่นคงของโครงสร้างพื้นฐานดิจิทัลทั่วโลก

ทีมข่าวกรองภัยคุกคามของ Google ระบุว่า พวกเขาได้ค้นพบหลักฐานที่เชื่อได้ว่าเป็นกรณีแรกในประวัติศาสตร์ ที่กลุ่มแฮกเกอร์ได้ประยุกต์ใช้เทคโนโลยีปัญญาประดิษฐ์ในการพัฒนาชุดคำสั่งเจาะระบบผ่านช่องโหว่แบบ Zero-Day ได้สำเร็จ

โดยบทความบนบล็อกเมื่อวันอังคารที่ผ่านมา ทางกลุ่มได้เปิดเผยว่า พบความเคลื่อนไหวของกลุ่มอาชญากรไซเบอร์ระดับแนวหน้าที่จับมือเป็นพันธมิตร เพื่อวางแผนปฏิบัติการเจาะระบบครั้งใหญ่ โดยอาศัยช่องโหว่ Zero-Day ที่เปิดทางให้พวกเขาสามารถข้ามผ่านระบบยืนยันตัวตนแบบสองปัจจัยของ เครื่องมือผู้ดูแลระบบแบบโอเพนซอร์สบนเว็บยอดนิยม ซึ่งทาง Google ไม่ได้ระบุชื่อแพลตฟอร์มอย่างเป็นทางการ

กลไกของการเจาะระบบในครั้งนี้ ผู้โจมตีจำเป็นต้องมีข้อมูลยืนยันตัวตนของผู้ใช้งานที่ถูกต้องในขั้นแรก แต่ความน่ากลัวคือมันสามารถข้ามผ่านการตรวจสอบในขั้นตอนที่สองได้อย่างแนบเนียน ซึ่งระบบ 2FA นี้นับเป็นมาตรฐานความปลอดภัยหลักที่มักถูกนำมาใช้เพื่อปกป้องบัญชีและกระเป๋าเงิน คริปโต ในปัจจุบัน

เทคโนโลยี AI ได้เข้ามามีบทบาทเพิ่มขึ้นอย่างมีนัยสำคัญ ทั้งในแวดวงความมั่นคงปลอดภัยทางไซเบอร์ และในหมู่แฮกเกอร์สาย คริปโต ที่พยายามแสวงหาช่องทางในการเจาะระบบหรือหลอกลวง สอดคล้องกับที่บริษัทด้านปัญญาประดิษฐ์อย่าง Anthropic ได้ออกมาเปิดเผยเมื่อเดือนที่แล้วว่า โมเดล AI ตัวล่าสุดอย่าง คลอดด์ มิธอส สามารถตรวจพบช่องโหว่ของซอฟต์แวร์ได้นับพันรายการในระบบปฏิบัติการหลักต่างๆ

Google ระบุว่ามีความมั่นใจในระดับสูงว่าผู้ไม่หวังดีน่าจะใช้ประโยชน์จากโมเดล AI เพื่อสนับสนุนการค้นหาและเปลี่ยนช่องโหว่นี้ให้กลายเป็นอาวุธ เนื่องจากชุดคำสั่งที่ใช้ในการเจาะระบบนั้น ปรากฏร่องรอยของอาการหลอน (Hallucination) และมีรูปแบบโครงสร้างที่เป็นลักษณะเฉพาะตัวสูงของชุดข้อมูลที่มักใช้ฝึกฝนโมเดล AI

แม้รายงานจะไม่ได้ชี้ชัดถึงตัวตนของกลุ่มผู้คุกคาม แต่ Google ได้ให้ข้อสังเกตเชิงยุทธศาสตร์ว่า ประเทศจีนและเกาหลีเหนือได้แสดงความสนใจอย่างมีนัยสำคัญในการใช้ประโยชน์จาก AI เพื่อการค้นหาช่องโหว่ของระบบ

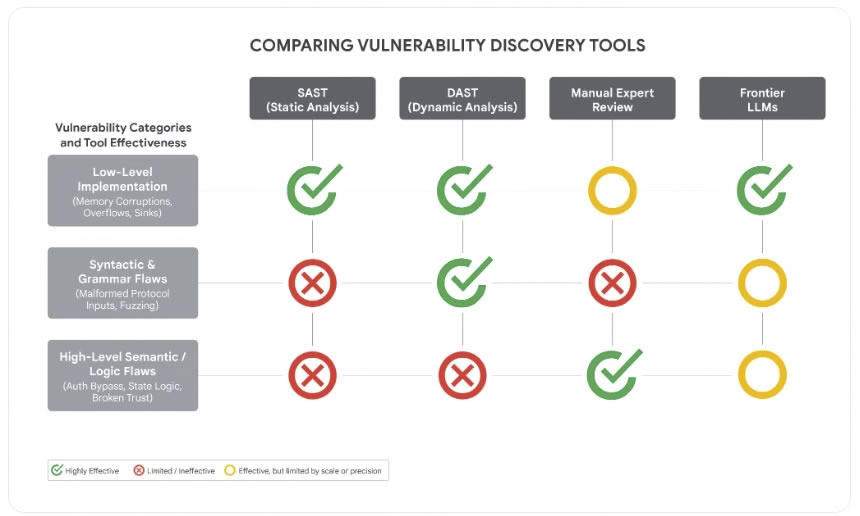

โมเดลภาษาขนาดใหญ่ (LLM) กับความเหนือชั้นในการระบุจุดบกพร่องระดับสูง

Google อธิบายเชิงลึกว่า ช่องโหว่ที่พบนี้ไม่ได้มีรากฐานมาจากข้อผิดพลาดในการเขียนโปรแกรมทั่วไปอย่างเช่นปัญหาหน่วยความจำขัดข้อง แต่เป็นข้อบกพร่องทางตรรกะเชิงความหมายระดับสูง (High-level Semantic Logic Flaw) ซึ่งเกิดจากการที่นักพัฒนาได้ฝังสมมติฐานความน่าเชื่อถือลงไปในรหัสคำสั่งอย่างตายตัว

สิ่งนี้เป็นนัยสำคัญที่บ่งชี้ว่า ผู้โจมตีได้เลือกใช้โมเดลภาษาขนาดใหญ่ (LLM) ระดับแนวหน้า เนื่องจากโมเดลเหล่านี้มีความเชี่ยวชาญเป็นเลิศในการระบุจุดบกพร่องระดับสูงและความผิดปกติเชิงสถิติที่ถูกฝังไว้ตายตัว ทาง Google กล่าวเสริม

นอกจากนี้ ยังพบว่ามีตระกูลมัลแวร์หลายสายพันธุ์ เช่น PROMPTFLUX, HONESTCUE และ CANFAIL ที่หันมาใช้ประโยชน์จาก LLM ในการหลบหลีกระบบป้องกัน โดยอาศัยความสามารถในการสร้างโค้ดลวงหรือโค้ดส่วนเกิน เพื่อพรางตรรกะการทำงานที่เป็นอันตรายให้รอดพ้นจากการตรวจจับ

การนำ LLM ไปใช้ในทางที่ผิดกำลังขยายตัวสู่ระดับอุตสาหกรรม

การลักลอบเข้าถึงและใช้งาน LLM อย่างผิดวัตถุประสงค์กำลังถูกยกระดับขึ้นสู่กระบวนการเชิงอุตสาหกรรม กลุ่มผู้คุกคามได้สร้างระบบท่อส่งข้อมูลอัตโนมัติเพื่อหมุนเวียนใช้งานบัญชี AI ระดับพรีเมียม การรวบรวมคีย์ API และการหลบหลีกมาตรการรักษาความปลอดภัยในสเกลระดับมหาศาล ซึ่งในทางปฏิบัติแล้ว นี่คือการดำเนินยุทธการโจมตีที่ได้รับการอุดหนุนต้นทุนจากการละเมิดบัญชีทดลองใช้งาน

นอกจากนี้ด้วยการใช้ประโยชน์จากเบราว์เซอร์ที่สามารถหลบหลีกการตรวจจับ และบริการรวบรวมบัญชี ผู้คุกคามกำลังพยายามรักษาสถานะการเข้าถึงโมเดล LLM ระดับพรีเมียมในปริมาณสูงและปกปิดตัวตน ซึ่งนับเป็นการยกระดับกระบวนการทำงานเชิงปองร้ายของพวกเขาเข้าสู่ระบบอุตสาหกรรมอย่างแท้จริง

Google สรุปทิ้งท้ายว่า ในขณะที่องค์กรต่างๆ กำลังเดินหน้าบูรณาการโมเดล LLM เข้าสู่ระบบปฏิบัติการจริงอย่างต่อเนื่อง ระบบนิเวศของซอฟต์แวร์ AI ก็ได้ก้าวขึ้นมาเป็นเป้าหมายหลักของการแสวงหาผลประโยชน์เช่นเดียวกัน

นอกจากนี้ ยังพบข้อสังเกตว่า กลุ่มผู้คุกคามกำลังพุ่งเป้าไปที่ส่วนประกอบที่ทำงานร่วมกัน ซึ่งทำหน้าที่มอบประโยชน์ใช้สอยให้กับระบบ AI มากยิ่งขึ้น เช่น ทักษะการทำงานอัตโนมัติ และตัวเชื่อมต่อข้อมูลจากบุคคลที่สาม อย่างไรก็ตาม จนถึงขณะนี้ กลุ่มอาชญากรไซเบอร์ยังไม่สามารถบรรลุขีดความสามารถขั้นทะลวงผ่านตรรกะความปลอดภัยแกนหลักของโมเดลระดับแนวหน้าได้สำเร็จ